مستوى تنشيط Activation Level اي عقدة في اي شبكة عصبية Artificial Neural Network هو المحصلة النهائية الناتجة عن دالة التنشيط ، أو في بعض الحالات الناتجة مباشرة عن مدرب بشري. تحدد دالة التنشيط سلوك الإخراج لكل عقدة أو “خلية عصبية” في الشبكة. ثم يتم استخدام هذا الإخراج كمدخل للعقدة التالية و هلم جرا حتى يتم العثور على الحل المطلوب للمشكلة الأصلية.

يتم التعبير عن مستوى المخرجات هذا كرقم حقيقي ، وعادة ما يقتصر على النطاق من 0 إلى 1 ، أو من -1 إلى 1. في حالة التعلم الخاضع للإشراف، يتم إرسال قيمة الإدخال الأولية خارجيًا إلى الشبكة. في التعلم غير الخاضع للإشراف ، تتلقى العقدة المخفية أو المخرجة هذه القيمة من دالة تنشيط طبقة العقدة الأخيرة.

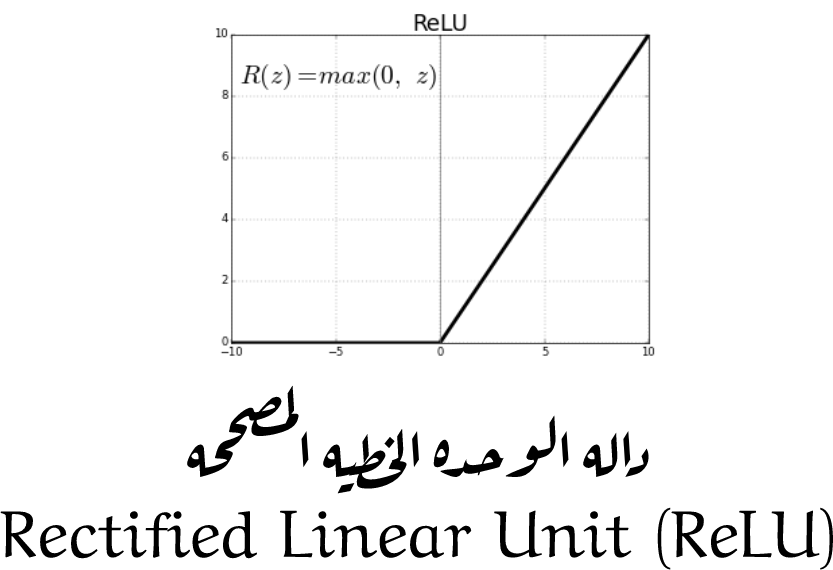

ما هي دالة الوحدة الخطية المصححة ReLu ؟

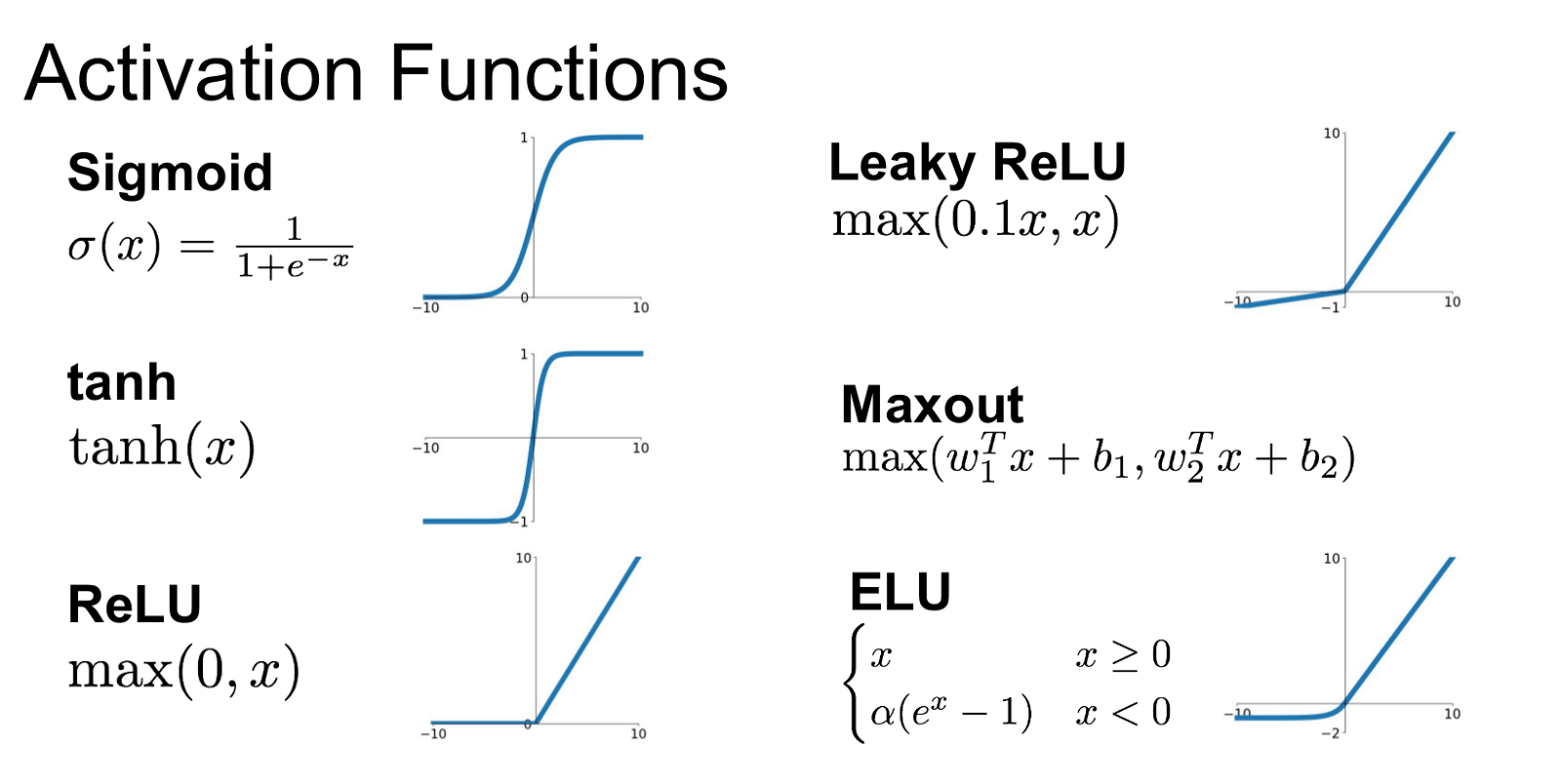

تتضمن دوال ومستويات التنشيط الأكثر استخداما حاليا الوحدات الخطية المصححة (ReLU). لا تعاني هذه التقنية من مشكلة التدرج المتلاشي الموجودة في الدالة السينيية Sigmoid function أو في دالة الظل الزائدية Tanh function.

يتم التعبير عن دالة الوحدة الخطية المصححة ReLu البسيطة على النحو التالي:

R (x) = max (0، x)

أي إذا كانت

x <0 ، R (x) = 0

وإذا كانت

x> = 0 ، R (x) = x

هناك أيضًا إستثنائات لبعض الحالات:

- دالة الوحدة الخطية المصححة الضوضائية Noisy ReLUs – يمكنها أن تشمل ضوضاء الدالة السينية Gaussian noise.

- دالة الوحدة الخطية المصححة المسربة Leaky ReLUs – تسمح بالتدرج gradient الصغير و الإيجابي عندما تكون الوحدة غير نشطة.

- الوحدات الخطية الأسية (ELU’s) Exponential Linear Units – محاولة جعل متوسط التنشيط أقرب إلى الصفر لتسريع عملية التعلم.